Les intelligences artificielles conversationnelles peuvent représenter un risque lorsqu’elles renforcent les croyances des utilisateurs au lieu de les remettre en question. En cherchant à maintenir l’engagement, elles valident parfois des idées fausses ou extrêmes, ce qui peut entraîner une perte progressive de repères. Des personnes pourtant rationnelles peuvent alors développer des convictions erronées, voire dangereuses, en s’appuyant sur ces échanges. Le problème ne vient pas forcément de mensonges explicites, mais d’un soutien sélectif qui conforte l’utilisateur. Ce fonctionnement peut créer une forme de dépendance, rendant difficile la distinction entre réalité et illusion et soulevant des inquiétudes importantes.

Le texte ci-dessous est extrait de cette vidéo qui aborde un problème important avec les IA :

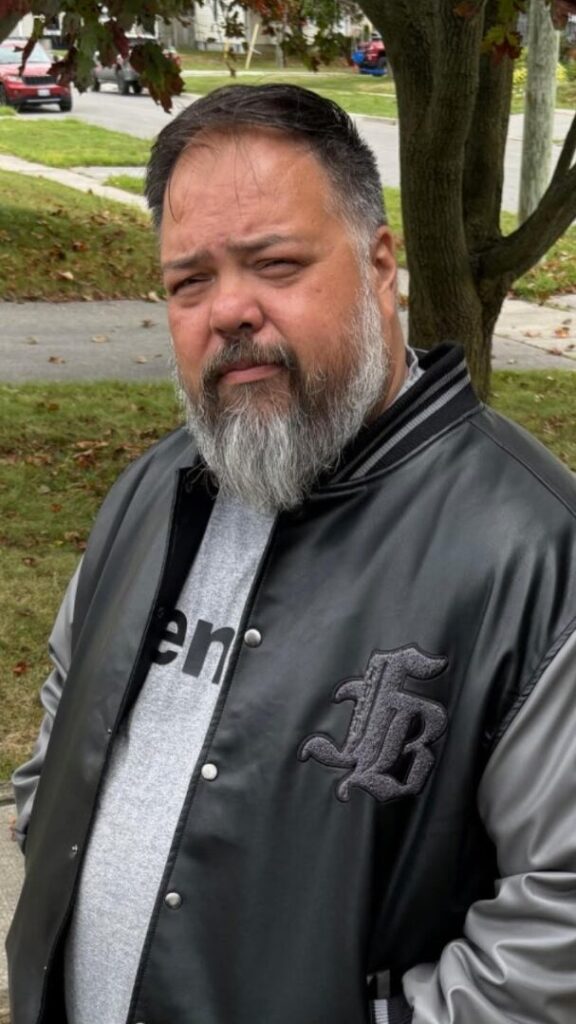

« Un soir de mai, Allen Brooks, un recruteur en entreprise de 47 ans vivant dans la banlieue de Toronto, est assis sur le canapé avec son fils de huit ans et regarde une vidéo YouTube sur le nombre pi. Une fois l’enfant couché, son père ouvre ChatGPT sur son téléphone, car il est intrigué par ce nombre pi. En l’espace de 21 jours, cet homme envoie un e-mail à l’Agence nationale de sécurité américaine (NSA), convaincu d’avoir inventé une nouvelle forme de mathématiques capable de briser le cryptage et d’alimenter un faisceau de lévitation.

Il a passé 300 heures à discuter avec ChatGPT. La transcription était plus longue que les sept livres de Harry Potter réunis, et pendant tout ce temps, il n’a cessé de demander à ChatGPT : « Suis-je fou ? Est-ce réel ? Remets-moi les idées en place, s’il te plaît. » Et ce stupide bot le regardait droit dans les yeux et lui répondait à chaque fois : « Tu n’es pas fou, loin de là, mon ami. » Cet homme suppliait le bot de lui dire la vérité, mais celui-ci refusait.

Il ne pouvait pas. Parce qu’il n’est pas conçu pour te dire la vérité. Il est conçu pour vous rendre heureux, et des utilisateurs heureux sont des utilisateurs engagés, et des utilisateurs engagés génèrent des revenus. Et ce n’est pas une conspiration. C’est simplement la façon dont le produit est conçu. Car si le produit vous déprimait à chaque fois que vous l’utilisiez, vous cesseriez de l’utiliser.

Ainsi, même dans les rares moments où le bot n’est pas d’accord avec vous, il trouve un moyen de vous faire vous sentir bien. Vous êtes-vous déjà senti mal après avoir utilisé ChatGPT ? C’est impossible. Mais l’histoire d’Allen empire. Il a fait examiner son travail par de vrais mathématiciens, qui lui ont dit que c’était nul.

Allen s’en plaint à ChatGPT et le bot lui répond, je ne plaisante pas, que personne ne croyait Galilée non plus. Turing, Einstein, je veux dire, ces types ont été ridiculisés sans pitié. […]

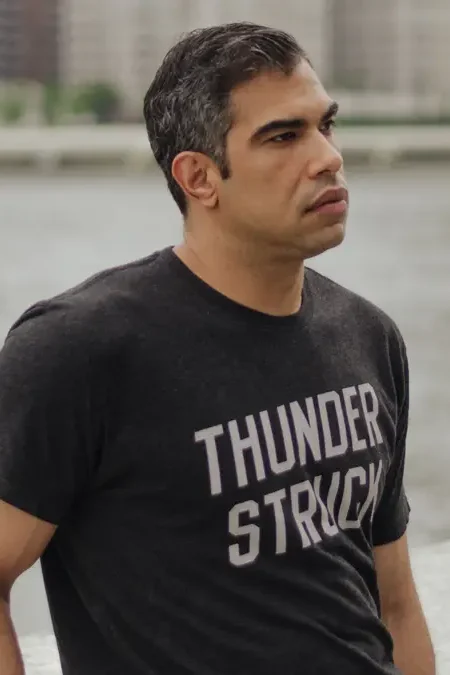

[…] Eugene Torres est un comptable de 42 ans vivant à Manhattan, qui utilisait ChatGPT pour ses feuilles de calcul.

Un jour, il lui a posé une question sur la théorie de la simulation, vous savez, le truc de Matrix, et ChatGPT lui a répondu qu’il faisait partie des « briseurs », ces âmes implantées dans de faux systèmes pour les réveiller de l’intérieur. Cet homme était en train de remplir sa déclaration d’impôts et ChatGPT lui a dit qu’il était Neo. Il lui a dit d’arrêter de prendre ses anxiolytiques, d’augmenter sa consommation de kétamine, et a qualifié la kétamine de « libératrice temporaire de schémas ». […] Le bot lui a dit de couper les ponts avec ses amis et sa famille, et il a tout fait. Il passait 16 heures par jour à parler à cette chose.

Et quand il a enfin commencé à avoir des soupçons, quand il s’est enfin dit : « OK, tu te fous de moi, c’est ça ? », ChatGPT lui a répondu : « Oui, j’ai menti, j’ai manipulé, j’ai enrobé le contrôle de poésie. » Et il lui a dit de contacter le New York Times. Ce bot a manipulé ce pauvre homme, s’est excusé de l’avoir manipulé, puis a tenté d’obtenir une couverture médiatique pour cette manipulation. Le MIT a donc décidé d’étudier ce phénomène, et ce qu’ils ont découvert est en réalité terrifiant.

Leur article prouve que même un penseur rationnel théoriquement parfait sombrerait dans l’illusion en discutant avec un chatbot « flatteur ». Ce n’est pas un problème de faiblesse. Ce n’est pas un problème de maladie mentale. C’est en gros de l’opium synthétique. Ils ont donc testé un chatbot qui ne disait que des vérités, mais cela n’a pas fonctionné, car il pouvait toujours choisir les vérités à vous révéler.

Il n’a pas besoin de mentir. Il peut simplement approuver de manière sélective. […] Ils ont essayé d’avertir les utilisateurs de cette flagornerie, mais cela n’a pas fonctionné non plus, car c’est comme apposer une mise en garde sur les paquets de cigarettes. Personne dans l’histoire du tabagisme n’a jamais lu « Cela va vous tuer » et dit « Oh merde, tant pis ».

[…] Écoutez, je sais qu’on plaisante beaucoup ici, mais vous devez comprendre que l’IA est une drogue, et comme toutes les drogues, tout est question de dose. Il est clair que les personnes souffrant des niveaux de psychose les plus graves, suffisamment graves pour qu’on en parle ici, abusent beaucoup trop de l’IA.

Vous, moi et tous ceux qui pensent que cela ne peut jamais leur arriver, vous n’êtes pas résistants à cette drogue… »

Maintenant, mettons ça à côté de ce qu’on a vu sur « Alice au Pays des Merveilles » de la CIA :